当人们提到大型语言模型(LLM)时,通常会想到像OpenAI的ChatGPT这样的产品,这类产品在各行业中广泛应用,如搜索引擎、语音助手和客户服务。然而,一个问题一直困扰着LLM的使用:它们需要进行大量的预训练和微调工作,这可能会花费大量的时间和资源。

最近,韩国研究人员通过从暗网中收集数据创造了一个新的LLM,名为“DarkBERT”。 DarkBERT基于BERT和RoBERTa,并利用Tor网络爬取了暗网数据进行训练。由于该数据包含黑客、诈骗党和罪犯的资料,因此该团队使用了预处理技术和分析权重等方法来排除受害者信息并过滤出原始资料来创建一组暗网数据库。此外,从论文中的表格可以看到,该数据库主要涉及成人图像、药物和金流等类别。

尽管DarkBERT的训练数据来源有争议,但该模型具有很多实际应用价值,例如检测勒索软件、侦测泄露机敏数据站点,或是实时监控非法信息等资案用途。虽然研究团队目前没有公布具体的计划,但可以申请使用DarkBERT以学术为目的。

点评:

即使从最不寻常的来源收集数据,也可以训练有用的人工智能模型。尽管一些人可能担心暗网数据对DarkBERT的影响,但这并没有阻止研究人员将其用于实际应用中。这表明,在AI技术迅速发展的今天,我们需要更加关注如何让这些技术在受控和透明的环境下运行,确保它们能够产生积极的社会效益。

Apple 苹果 MacBook Air 2023款 15.3英寸笔记本电脑(M2、8GB、256GB)

Apple 苹果 MacBook Air 2023款 15.3英寸笔记本电脑(M2、8GB、256GB)

DELL 戴尔 XPS 13 9315 十二代酷睿版 13.4英寸 轻薄本

DELL 戴尔 XPS 13 9315 十二代酷睿版 13.4英寸 轻薄本

ASUS 华硕 灵耀14 2023款 十三代酷睿版 14.0英寸 轻薄本

ASUS 华硕 灵耀14 2023款 十三代酷睿版 14.0英寸 轻薄本

Apple 苹果 iPad 10.2英寸平板电脑 (256GB WLAN版/A13) 银色

Apple 苹果 iPad 10.2英寸平板电脑 (256GB WLAN版/A13) 银色

Apple 苹果 MacBook Pro 14英寸笔记本电脑(M1 Pro、16GB、512GB)

¥11399

¥14999

Apple 苹果 MacBook Pro 14英寸笔记本电脑(M1 Pro、16GB、512GB)

¥11399

¥14999

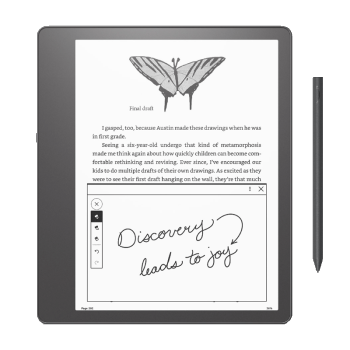

kindle Scribe 10.2英寸电子书阅读器 16GB

kindle Scribe 10.2英寸电子书阅读器 16GB

Hanvon 汉王 Clear 7英寸电子书阅读器平板

Hanvon 汉王 Clear 7英寸电子书阅读器平板

HUAWEI 华为 平板 11.5英寸 2023款 120Hz护眼全面屏 WiFi 8G+256G

HUAWEI 华为 平板 11.5英寸 2023款 120Hz护眼全面屏 WiFi 8G+256G

MI 小米 平板6 Pro 11英寸

MI 小米 平板6 Pro 11英寸

网友评论