据报道,美国国防部正在与初创公司Scale AI合作,测试用于军事用途的生成式人工智能模型。

Scale AI将建立一个工具和数据集框架,五角大楼可以部署这些工具和数据集来评估大型语言模型。该框架将包括“测量模型性能,为作战人员提供实时反馈,并创建专门的公共部门评估集,以测试用于军事支持应用的人工智能模型,例如组织行动后报告的调查结果”,这家总部位于旧金山的企业告诉DefenseScoop。

大型语言模型分析和生成文本的能力可以提高五角大楼收集情报、制定行动计划的能力,从而指导作战领域的决策。

国防部首席数字和人工智能官员Craig Martell说:“想象一下这样一个世界,战斗指挥官可以看到他们做出战略决策所需的一切。”

他在“优势国防部2024:国防数据和人工智能研讨会”(Advantage DoD 2024: Defense Data and AI Symposium)上宣布:“想象一下这样一个世界,作战指挥官不再通过PowerPoint或电子邮件从整个[组织]获取信息——态势感知的周转时间从一两天缩短到十分钟。”

人工智能可以快速处理大量信息。然而,军事数据通常是高度敏感的——官员们担心,如果涉及到大型语言模型,及时的注入攻击或API滥用可能会导致数据泄露。

军事应用LLM的最大障碍是它们往往会产生不准确或虚假的信息——被称为幻觉。五角大楼认为,通过引入大规模人工智能,它可以测试不同模型的性能,以识别潜在风险,然后再考虑使用它们来支持战争或情报。

据报道,这家初创公司将编制“抵抗数据集”,其中包含对输入提示的有效响应示例,这将对军方有用。然后,国防部官员可以比较不同模型对相同提示的反应,并评估它们的效用。

去年,美国国防部成立了利马特别工作组(Task Force Lima),由曾在拼车业务Lyft担任机器学习主管的Martell领导,负责研究生成式人工智能的军事应用。

“国防部必须负责任地采用生成式人工智能模型,同时确定适当的保护措施,并减轻可能因培训数据管理不善等问题而导致的国家安全风险。”Martell当时解释说。“我们还必须考虑我们的对手将在多大程度上利用这项技术,并寻求破坏我们自己对基于人工智能的解决方案的使用。”

然而,像ChatGPT这样的工具在内部已经被暂时禁止了。由于担心军事机密可能被泄露或提取,美国太空部队告知工作人员不要使用该软件。

Scale AI拒绝就此事置评。

原文《US Department of Defense enlists Scale AI to help the military get smarter》

HONOR 荣耀 Magic5 Pro 5G智能手机 16GB+512GB 燃橙色

HONOR 荣耀 Magic5 Pro 5G智能手机 16GB+512GB 燃橙色

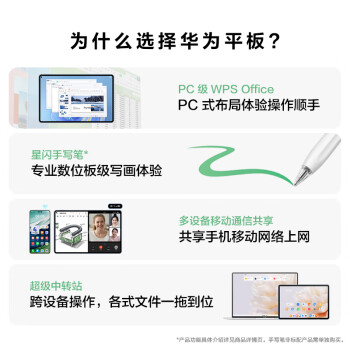

HUAWEI 华为 MatePad Pro 11英寸2024款华为平板电脑2.5K屏卫星通信星闪技术办公学生学习12+256GB WIFI星河蓝

HUAWEI 华为 MatePad Pro 11英寸2024款华为平板电脑2.5K屏卫星通信星闪技术办公学生学习12+256GB WIFI星河蓝

EHOMEWEI 一泓微 RQ3 17英寸QLED便携式显示器

EHOMEWEI 一泓微 RQ3 17英寸QLED便携式显示器

ikbc C104 104键 有线机械键盘 侧刻 黑色 Cherry红轴 无光

ikbc C104 104键 有线机械键盘 侧刻 黑色 Cherry红轴 无光

HONOR 荣耀 60 Pro 5G手机 12GB+256GB 亮黑色

HONOR 荣耀 60 Pro 5G手机 12GB+256GB 亮黑色

Dareu 达尔优 小方糖Z82 82键 2.4G蓝牙 多模无线机械键盘 帆布白 凯华轻音轴 单光

Dareu 达尔优 小方糖Z82 82键 2.4G蓝牙 多模无线机械键盘 帆布白 凯华轻音轴 单光

SAMSUNG 三星 Galaxy S24 5G手机 8GB+256GB 骁龙8Gen3

SAMSUNG 三星 Galaxy S24 5G手机 8GB+256GB 骁龙8Gen3

ViewSonic 优派 VX2757-2K-PRO 27英寸Fast-IPS显示器(2560*1440、180Hz、100%sRGB、HDR10)

ViewSonic 优派 VX2757-2K-PRO 27英寸Fast-IPS显示器(2560*1440、180Hz、100%sRGB、HDR10)

NICEHCK 钛美X39 入耳式有线耳机

NICEHCK 钛美X39 入耳式有线耳机

网友评论