NVIDIA Blackwell AI芯片在最新的MLPerf Inference v4.1基准测试中首次亮相,便以卓越的性能刷新了多项AI性能记录。同时,Hopper系列芯片H100和H200继续保持行业领导地位,表现优于AMD的MI300X。

在MLPerf推理和AI基准测试中,NVIDIA Blackwell AI芯片在所有测试项目中均取得了创纪录的成绩,展现了其在AI领域的强大实力。这款芯片预计将于今年年底前进入数据中心市场,有望成为市场上最强大的AI解决方案,其代际性能提升高达4倍。

此次测试中,NVIDIA Blackwell AI芯片在以下AI基准测试中表现突出:

- Llama 2 70B(密集型语言模型)

- Mixtral 8x7B MoE(稀疏专家混合法学硕士)

- 稳定扩散(文本到图像生成)

- DLRMv2(推荐系统)

- BERT(自然语言处理)

- RetinaNet(目标检测)

- GPT-J 6B(密集型语言模型)

- 3D U-Net(医学影像分割)

- ResNet-50 v1.5(图像分类)

特别值得一提的是,在Llama 2 70B测试中,Blackwell AI芯片的性能相较于Hopper H100芯片有显著提升。在服务器工作负载中,单个Blackwell GPU的性能提升了4倍(10,756 Tokens/秒),而在离线场景中,性能提升了3.7倍,达到11,264 Tokens/秒。此外,NVIDIA还首次公开测量了Blackwell GPU运行FP4的性能。

与此同时,NVIDIA Hopper系列芯片H100和H200在各项测试中均领先于AMD MI300X。在最新的基准测试中,如“Mixtral 8x7B”LLM(560亿参数),Hopper芯片展现了卓越的性能。

NVIDIA HGX H200配备了8个Hopper H200 GPU和NVSwitch,在Llama 2 70B测试中,性能提升显著,令牌生成速度分别为34,864(离线)和32,790(服务器)。与此相比,Hopper H100解决方案的性能提高了50%。这一性能提升得益于适用于两种Hopper芯片的软件优化,以及H200芯片相关的80%内存容量和40%的带宽提升。

在多GPU测试服务器中,NVIDIA H100和H200在Mixtral 8x7B测试中分别提供了高达59,022和52,416个令牌/秒的输出。AMD的Instinct MI300X在此特定工作负载中并未提交成绩。

NVIDIA对软件的精细调校取得了显著成果,每个MLPerf版本中都实现了重大提升,这种优势直接传递给了使用Hopper GPU的服务器客户。人工智能和数据中心领域,不仅关乎硬件,软件同样重要。NVIDIA拥有完善的生态系统,已准备好向全球企业和AI巨头全面推出HGX H200。

此外,NVIDIA的边缘解决方案,如Jetson AG Orin,自MLPerf v4.0提交以来,也实现了6倍的性能提升,对边缘GenAI工作负载产生了巨大影响。

随着Blackwell芯片在发布前展示了如此强大的性能,我们有理由期待,这款为AI量身定制的新架构将变得更加强大,并在明年将优化优势传递给Blackwell Ultra。

北京消费券:ASUS 华硕 无畏Pro15 2024 15.6英寸笔记本电脑(R7 8845H、16GB、1TB)

北京消费券:ASUS 华硕 无畏Pro15 2024 15.6英寸笔记本电脑(R7 8845H、16GB、1TB)

HONOR 荣耀 V8 Pro 12.1英寸平板电脑 8GB+256GB WIFI版

HONOR 荣耀 V8 Pro 12.1英寸平板电脑 8GB+256GB WIFI版

外星人16英寸m16R2游戏本

¥12269

¥12915

外星人16英寸m16R2游戏本

¥12269

¥12915

AMD 9000系列新品锐龙R7 9700X组装电脑 AMD全家桶电竞直播电脑主机 AIdiy R7

AMD 9000系列新品锐龙R7 9700X组装电脑 AMD全家桶电竞直播电脑主机 AIdiy R7

HP 惠普 光影精灵8 16.1英寸 游戏本 (R7-6800H、16G、512GB 、RTX3050

¥5499

¥6099

HP 惠普 光影精灵8 16.1英寸 游戏本 (R7-6800H、16G、512GB 、RTX3050

¥5499

¥6099

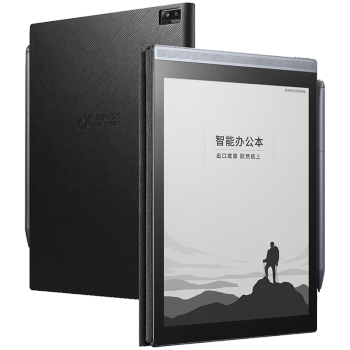

iFLYTEK 科大讯飞 Air 7.8英寸墨水屏电子书阅读器 WiFi 32GB 深空灰

iFLYTEK 科大讯飞 Air 7.8英寸墨水屏电子书阅读器 WiFi 32GB 深空灰

Lenovo 联想 拯救者 Y9000X 2024款 16英寸 游戏本

Lenovo 联想 拯救者 Y9000X 2024款 16英寸 游戏本

FIREBAT 火影 众颜U4 14英寸笔记本电脑(R7-6800H、16GB、512GB)

¥3999

¥4299

FIREBAT 火影 众颜U4 14英寸笔记本电脑(R7-6800H、16GB、512GB)

¥3999

¥4299

天钡 赛博GOD88 迷你主机(R7-8845HS、准系统)

天钡 赛博GOD88 迷你主机(R7-8845HS、准系统)

网友评论