在2025年的科技浪潮中,人工智能(AI)已然成为推动产业升级的核心引擎。作为全球半导体巨头的英特尔,正以迅猛之势切入AI专业显卡领域,回溯到今年COMPUTEX 2025期间,英特尔正式发布了ARC PRO B系列专业显卡,这一系列产品迅速吸引了业界的目光。

而在最近举办的湾区半导体大会(湾芯展)上,英特尔正式推出了基于英特尔锐炫™ Pro系列GPU的多卡互联方案——Battlematrix(战斗阵列)推理工作站平台。旨在突破单GPU的算力与应用瓶颈,为从边缘计算、企业部门级工作站到数据中心服务器的广泛应用场景,提供一个兼具高效能与成本效益的AI部署新范式,致力于将AI的巨大潜力转化为触手可及的生产力。

AI发展趋势剖析:从感知到物理,AI进入新纪元

英特尔中国区显卡和AI高级产品总监徐金平首先回顾了AI的演进路径,AI的发展可大致分为以下四个阶段:感知 AI、生成式 AI、智能体 AI,以及物理 AI。其中,所谓「感知 AI」,是人工智能的初始阶段,这个阶段的 AI 让机器开始具备感知能力,即理解和处理来自外界的资讯。而「生成式AI 」大家应该已经很熟悉了,以ChatGPT、Stable Diffusion、Sora以及国内模型为代表的大模型在过去三年迅猛发展,为大家的内容创作带来了不少益处。

至于「智能体AI 」则可以理解为一个聪明的助手、具备一部分「决策能力」的 ChatGPT。它不仅能理解你的需求,还能自己决定如何完成这些需求,并且使用各种工具来帮助达成目标。「物理AI 」则更为出众,不仅能够感知和理解环境、进行决策,还能直接执行物理操作,如机器人搬运物品或协助人类完成复杂任务。

模型规模化则是AI发展的另一焦点。从AlexNet的6000万参数,到BERT的3.4亿、GPT-3的1750亿,再到2025年的Kimi K2(1万亿参数),目前火热的Sora 2、GPT-5等参数量虽然没公布,但肯定也是万亿级别,在可以预见的未来,AI模型的参数量还将持续膨胀。同时,小模型优化趋势兴起,旨在边缘设备上实现大模型能力。英特尔的ARC PRO B系列专业显卡正是为应对这一双轨发展而设计,支持从大参数训练到小模型的全链路部署。

英特尔产品矩阵:专为企业和边缘AI打造的“甜点级”GPU

从徐金平总监分析的AI发展趋势不难看出,当前企业在拥抱AI浪潮时普遍面临一个核心难题:一方面是大模型商业化应用近在咫尺,机遇诱人;另一方面,海量多模态数据的处理和复杂精细化模型的部署,对传统算力架构的性能、能耗和成本都带来了严峻挑战 。英特尔此次推出的锐炫多卡方案,正是为了破解这一难题,为AI技术的大规模、普惠化落地筑牢根基。

英特尔ARC PRO B系列包含ARC PRO B60以及ARC PRO B50两款产品,Arc Pro B50相较上代A50仅6GB显存,直接把容量扩展至16GB;而面向推理工作站的Arc Pro B60更是把显存堆到了24GB。并且两款显卡的单芯功耗均没有超过200W。

在性能表现上,以本地大模型推理为例,ARC PRO B60得益于更大的24GB显存,在不少大模型的推理场景下,速度最高可达竞争对手(如NVIDIA RTX 5060 Ti)的2.7倍。这就意味着在产品的“性价比”、特别是对超大显存有需求的应用场景来说,英特尔ARC PRO B系列在如今的目标市场里,有着一个明显的“大显存”、“高速度”优势。

此外,ARC PRO B系列产品还支持灵活的系统接口,包括PCIe 5.0×8与单卡双芯架构,这为多卡集群提供了基础。以目前已经发布的ARC PRO B60 Dual为例,它就可以在双槽、单卡体积下,实现双倍的计算密度和高达48GB的单卡显存容量。相比之下,传统专业显卡往往需要多卡堆叠,导致机箱体积庞大和散热挑战。

Battlematrix项目:多卡互联,突破AI瓶颈

在本次湾芯展上,英特尔还展示了一系列名为“战斗阵列”的推理工作站平台设计,这些可扩展的PC平台采用酷睿或至强CPU,搭配ARC PRO B系列显卡,在很紧凑的双槽小机箱里就可以提供48GB显存的硬件规格。如果是8槽规格的机架或高塔工作站,那么其更是可实现四卡、八芯、共384GB显存的惊人规格。与竞品相比,英特尔的产品在功耗和体积上更具优势,同时也特别适合中小企业和研究机构,可避免高昂的机房投资。

英特尔推出的战斗阵列推理工作站平台还有诸多优势,例如在互联技术上,ARC PRO B系列支持GPU direct peer to peer互联,这允许多个GPU之间直接访问彼此显存,而无需通过CPU中转。这种机制大大降低了延迟,尤其在多卡并行训练大模型时表现突出。

其次,英特尔引入了GPU over fabric通信协议,支持跨服务器的显卡集群扩展。这意味着用户可以轻松构建分布式AI基础设施,而无需复杂的网络配置。相比NVIDIA的NVLink等专有技术,英特尔的方案更注重开放性和兼容性,能与第三方硬件无缝集成。

性能之外,英特尔还强调了软件生态的支撑。OneAPI框架统一支持PyTorch、vLLM、OneDNN、OneCCL等开源库,优化主流框架。容器化方案让中小企业无需深度开发即可部署。同时英特尔还有传统艺能,就是经常能对新游戏或新模型提供“0day”支持。这意味着开发者在模型上线首日即可利用ARC PRO B系列进行优化,而无需等待驱动更新。这种前瞻性支持,是英特尔全栈优势的体现——作为少数同时掌握多种计算单元的企业,英特尔能从底层确保兼容性和稳定性。

针对不同企业、不同场景的AI部署需求,英特尔也提供了灵活的产品形态选择,如:针对个人和边缘侧轻量级AI推理场景:提供搭载1块英特尔® 酷睿™ 处理器和1-2块英特尔锐炫Pro B60 GPU的方案,支持7B至32B模型,实现单用户到16+多用户的并发处理。

针对通用工作站及服务器场景:通过搭载英特尔® 至强® 处理器平台,并配置4块英特尔锐炫Pro B60 GPU,可支持32B至70B模型,满足50+用户的并发需求。

针对专用AI服务器场景:可借助2块英特尔® 至强® 处理器平台和8-16块英特尔锐炫Pro B60,支持32B至100B模型,服务100+以上用户。

由此一来,无论是个人电脑、边缘设备、通用工作站/服务器,乃至专用AI服务器,都能找到与之匹配的高效且具备成本优势的部署方案,这正是英特尔助力更多企业快速推进AI部署与实践的具体体现。

英特尔远大GPU规划:构筑差异化竞争护城河

后续的深度沟通中我们也进一步了解到:面对激烈的市场竞争,英特尔选择了一条差异化路线 ,其核心并非单纯比拼硬件参数,而是依托其深厚的产业根基,通过开放软件生态、全栈协同方案和成本效益三大基石,构筑一道坚固的竞争护城河。

英特尔最大的优势之一,在于其数十年在计算领域耕耘所积累的深厚软件实力。面对行业内部分封闭的生态系统,英特尔坚定地推行“拥抱开放”的软件策略 。其核心是通过oneAPI统一编程模型,为开发者提供跨架构的编程能力,同时积极拥抱并优化PyTorch、vLLM等行业最流行的开源AI框架。这样不仅为客户提供了极大的灵活性,也大大降低了应用迁移和开发的门槛。

而Battlematrix(战斗阵列)多卡方案则是英特尔的第二大优势——全栈协同。目前市面上的大多数相关芯片企业往往只具备单一类别产品的研发能力,比如只做CPU、GPU,或是只研发加速卡。这种多品牌产品组成的AI方案,往往很难保证兼容性与稳定性,Battlematrix(战斗阵列)多卡方案是基于自家的至强®处理器与锐炫™ Pro GPU在硬件和软件层面进行深度整合与验证,能够提供长期的技术支持,也极大地简化了部署流程,让客户能更快地将精力聚焦于上层应用的开发。

至于成本效益上,英特尔看重的并非狭义的硬件采购价格,而是涵盖了服务器、功耗、散热以及实际模型产出效率在内的综合成本。英特尔希望通过提供一个价格极具竞争力、能效优异且软件开放的平台,让客户的每一分投资都能产生最大的回报。

结语

随着Battlematrix(战斗阵列)多卡方案的正式推出,以及与众多OEM厂商在服务器和工作站适配上的深入合作,英特尔正逐步构建起一个从硬件到软件、从产品到解决方案的完整AI生态系统,致力于让AI部署更普惠、更便捷。为开发者,为企业带来更多选择,打破垄断格局,最终惠及整个产业。

诺希 适用于红米NOTE4手机电池 加强版 内置电池更换大容量 通用红米NOTE4/NOTE4X(高配版4GB)/BN41

诺希 适用于红米NOTE4手机电池 加强版 内置电池更换大容量 通用红米NOTE4/NOTE4X(高配版4GB)/BN41

CAPERE (铠雷) 防水乱纹提花游戏【轻粗面控制涩垫】鼠标垫顺滑表面细沙感定位精准电脑竞技滑鼠垫 乱纹提花游戏垫【大号黑色】

CAPERE (铠雷) 防水乱纹提花游戏【轻粗面控制涩垫】鼠标垫顺滑表面细沙感定位精准电脑竞技滑鼠垫 乱纹提花游戏垫【大号黑色】

大水牛(BUBALUS)寒战240 一体式CPU水冷散热器(多平台/支持IntelLGA2011/AMD/幻彩冷头/PWM智能温控/电脑风扇)

大水牛(BUBALUS)寒战240 一体式CPU水冷散热器(多平台/支持IntelLGA2011/AMD/幻彩冷头/PWM智能温控/电脑风扇)

Great Wall 长城 本色 K-13 RGB ATX机箱 全侧透

Great Wall 长城 本色 K-13 RGB ATX机箱 全侧透

倍思【超薄水晶透明壳丨还原裸机】适用iphone17promax手机壳苹果17promax保护套原装全包透明防摔散热

倍思【超薄水晶透明壳丨还原裸机】适用iphone17promax手机壳苹果17promax保护套原装全包透明防摔散热

爱图仕(Aputure) 艾蒙拉 300c 全彩视频直播间补光灯300w拍照摄影灯rgb专业影视灯光氛围发丝美颜深抛柔光灯箱罩 艾蒙拉 300c 灰色 艾蒙拉(amaran)

爱图仕(Aputure) 艾蒙拉 300c 全彩视频直播间补光灯300w拍照摄影灯rgb专业影视灯光氛围发丝美颜深抛柔光灯箱罩 艾蒙拉 300c 灰色 艾蒙拉(amaran)

毕亚兹适用华为MatePad第二代\第三代 M-Pencil充电器 平板手写笔充电器一插即充磁吸吸附充电线棒 PB429

毕亚兹适用华为MatePad第二代\第三代 M-Pencil充电器 平板手写笔充电器一插即充磁吸吸附充电线棒 PB429

PGYTECH相机背带微单反挂绳相机挂脖快拆挂扣蒲公英相机肩带适用索尼佳能富士尼康相机配件挂绳(旷野绿)

PGYTECH相机背带微单反挂绳相机挂脖快拆挂扣蒲公英相机肩带适用索尼佳能富士尼康相机配件挂绳(旷野绿)

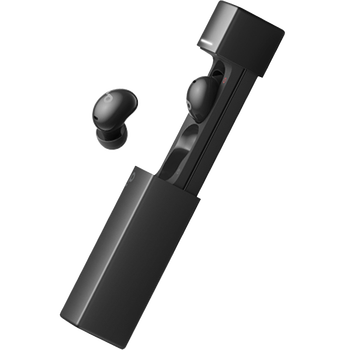

声阔(SoundCore)A30i蓝牙耳机真无线入耳式主动降噪防水长续航适配小耳朵适用苹果华为小米黑

声阔(SoundCore)A30i蓝牙耳机真无线入耳式主动降噪防水长续航适配小耳朵适用苹果华为小米黑

网友评论