近日,OpenAI与美国演员工会(SAG - AFTRA)等共同发布联合声明,宣布建立深度合作机制,重点防范其AI视频生成工具Sora可能引发的深度伪造(Deepfake)滥用问题。

Sora是OpenAI推出的文本到视频生成模型,自曝光以来备受全球关注。它具备“1分钟长视频生成”“物理规律模拟”“多镜头叙事”等强大能力。然而,其强大的内容生成能力也带来了深度伪造风险。不法分子可能利用该技术伪造名人影像、篡改历史事件或制造虚假新闻,这对个人名誉、社会信任甚至国家安全都会构成威胁。

当地时间10月20日,因在9月底Sora 2上线后,有用户在平台上生成了未经授权、模仿演员布莱恩·克兰斯顿声音与形象的AI视频,引发了这位《绝命毒师》主演的担忧。克兰斯顿表示,感谢OpenAI制定政策并完善防护机制,希望从事这一领域的公司尊重个人管理声音与形象复制权的职业权利。

除了美国演员工会,OpenAI还将与代表克兰斯顿的联合人才经纪公司(UTA)、经纪人协会(ATA)及创意艺术家经纪公司(CAA)展开合作,进一步强化对未经授权AI生成内容的防护。此前,CAA和UTA曾公开批评OpenAI在Sora中使用受版权保护素材的做法,称其对客户及其知识产权构成威胁。

另外,上周因Sora用户生成对民权领袖马丁·路德·金的不敬形象,OpenAI应马丁·路德·金遗产委员会的要求,在Sora平台封禁了相关视频。

自9月30日Sora 2推出以来,OpenAI在版权与肖像使用政策方面持续调整。10月3日,OpenAI首席执行官更新了Sora的“退出(opt - out)政策”,新政策赋予权利人“更精细的角色生成控制权” 。在Sora推出时,平台就要求对个人声音与肖像的使用需经授权同意(opt - in),随后又进一步承诺迅速回应任何相关投诉。

此次合作中,OpenAI承诺在Sora的后续版本中实施严格的“选择加入”(Opt - In)政策。所有艺术家、表演者及普通用户需明确授权后,其声音、肖像方可被用于AI生成内容。例如,若用户希望生成布莱恩·克兰斯顿的虚拟影像,必须通过其本人或授权代表的确认,并明确使用场景与期限。

同时,OpenAI将建立快速响应机制,对涉嫌侵权的生成内容进行下架处理,并配合执法部门追溯源头。此外,OpenAI宣布向合作方开放部分技术细节,鼓励第三方机构开发深度伪造检测工具。目前,已有斯坦福大学、MIT等高校参与相关研究,试图通过算法识别AI生成内容的微小瑕疵。

OpenAI还重申支持美国的《禁止伪造法案》,该法案旨在防止未经授权AI生成他人声音或肖像。

Sora

Sora

JPLAYERType-c数据线6A超级快充22.5W充电线车载适用华为Mate60Pro/Pura70/P50/40荣耀小米平板手机线1米

JPLAYERType-c数据线6A超级快充22.5W充电线车载适用华为Mate60Pro/Pura70/P50/40荣耀小米平板手机线1米

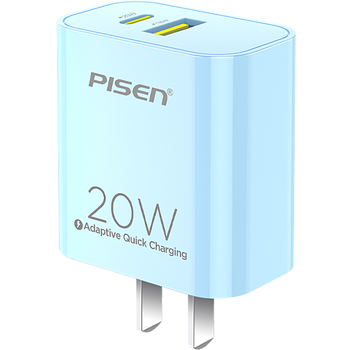

品胜3C认证 氮化镓苹果充电器PD20W快充电头双口USB+Type-C口通用iPhone17/16/15/14小米华为手机平板

品胜3C认证 氮化镓苹果充电器PD20W快充电头双口USB+Type-C口通用iPhone17/16/15/14小米华为手机平板

TAMRON 腾龙 35-150mm F2.0 Di III VXD 远摄变焦镜头 索尼E卡口 82mm

TAMRON 腾龙 35-150mm F2.0 Di III VXD 远摄变焦镜头 索尼E卡口 82mm

京东方健康全景读写台远像读写平台拉远镜读写仪远距离光学阅读写字远像仪 官方正品

京东方健康全景读写台远像读写平台拉远镜读写仪远距离光学阅读写字远像仪 官方正品

索尼(SONY)WH-1000XM6 双芯超旗舰头戴式降噪耳机 蓝牙耳机 头戴式耳机 重磅新品 WH-1000XM5升级版 黑色

索尼(SONY)WH-1000XM6 双芯超旗舰头戴式降噪耳机 蓝牙耳机 头戴式耳机 重磅新品 WH-1000XM5升级版 黑色

索尼(SONY)WF-C510轻巧舒适真无线蓝牙耳机 IPX4防护轻便长续航 支持高清通话蓝牙5.3耳麦 黑色

索尼(SONY)WF-C510轻巧舒适真无线蓝牙耳机 IPX4防护轻便长续航 支持高清通话蓝牙5.3耳麦 黑色

绿联 130W车载充电器超级快充点烟器一拖三适用苹果17/16华为小米汽车 【130W-双C+USB】笔记本手机快充

绿联 130W车载充电器超级快充点烟器一拖三适用苹果17/16华为小米汽车 【130W-双C+USB】笔记本手机快充

ROG魔导士Ace HFX磁轴电竞键盘 游戏有线键盘 Gasket 8K回报率 小蜜蜂战队同款 UV涂层 ABS版

ROG魔导士Ace HFX磁轴电竞键盘 游戏有线键盘 Gasket 8K回报率 小蜜蜂战队同款 UV涂层 ABS版

图拉斯【无线快充苹果17】磁吸充电宝3C认证可上飞机超薄便携小巧1万毫安移动电源适用iPhone16华为 灰

图拉斯【无线快充苹果17】磁吸充电宝3C认证可上飞机超薄便携小巧1万毫安移动电源适用iPhone16华为 灰

网友评论