随着大语言模型在文本分析、智能问答等场景的广泛应用,处理1M超长文本推理时,常常面临显存不足、运算速度卡顿的行业痛点,严重限制了超长文本场景的应用。近日,上海交通大学李健教授团队依托上海交通大学 鲲鹏昇腾科教创新卓越中心的算力支持,基于vLLM-Ascend 推理框架研发出一套针对超长上下文推理的稀疏注意力 KV Cache 分层缓存管理系统。在昇腾 AI 软硬件平台的全方位赋能下,该项目成功破解单卡支持超长上下文推理的显存与性能双重难题,同时大幅提升吞吐量。

项目核心创新在于设计了 KV Cache 分级缓存集成机制。该机制先对推理任务进行实时分析,智能识别Top-K 重要块并集中算力处理,从源头提升计算效率;同时采用数据冷热分层存储策略,根据数据访问频率,将生成数据动态划分为高频热数据与低频冷数据,再针对性优化存储位置,减少资源浪费。这一机制的落地依托昇腾CANN异构计算架构灵活的动态调度能力,能精准控制冷热数据在显存与主存间的流转,大幅降低数据迁移开销。最终,该方案实现单卡流畅处理超过1M的超长文本推理任务,系统推理吞吐量超过39%,彻底突破传统系统在长序列处理上的显存与性能瓶颈。

同时项目进行了元数据结构优化与缓存机制设计,其中数据索引与掩码是关键支撑 —— 通过精简索引结构、合并掩码维护步骤,有效减少重复运算,使昇腾NPU算力更集中于注意力计算与文本生成等核心任务,提升硬件利用效率。相关优化已通过vLLM-Ascend推理框架灵活集成,保障了技术方案的顺利落地。

目前,该项目源代码已在 Gitee 社区中开源,后续将进一步推送到昇腾开源生态,合入GitHub社区 vLLM-Ascend 项目专区。此次技术突破,不仅为超长文本推理提供了高效解决方案,更印证了昇腾生态在AI创新中的赋能价值。未来,随着该系统在更多行业场景的落地,昇腾将持续为AI技术研发提供算力与技术保障,推动大语言模型在长文本分析、智能办公、数字孪生等千行百业的深度应用,加速人工智能产业化进程。

HIKVISION海康威视监控摄像头200万红外全彩夜视AI人形检测poe网线供电家用室内半球监控T12HV3-LA 4MM

HIKVISION海康威视监控摄像头200万红外全彩夜视AI人形检测poe网线供电家用室内半球监控T12HV3-LA 4MM

贝尔金(BELKIN)Type-C转HDMI2.1转换器 笔记本电脑USB拓展8K视频转换器 0.2米USB-C扩展 AVC013

贝尔金(BELKIN)Type-C转HDMI2.1转换器 笔记本电脑USB拓展8K视频转换器 0.2米USB-C扩展 AVC013

索尼(SONY)27英寸 2K 480Hz INZONE 英纵 M10S OLED电竞显示器 DP2.1接口 FPS Pro+模式

索尼(SONY)27英寸 2K 480Hz INZONE 英纵 M10S OLED电竞显示器 DP2.1接口 FPS Pro+模式

ANKER 安克【1件包邮】60WPD快充MFi认证数据线CL充电宝充电器充电线适配苹果14/13/12light接口 丁香紫 0.9米

ANKER 安克【1件包邮】60WPD快充MFi认证数据线CL充电宝充电器充电线适配苹果14/13/12light接口 丁香紫 0.9米

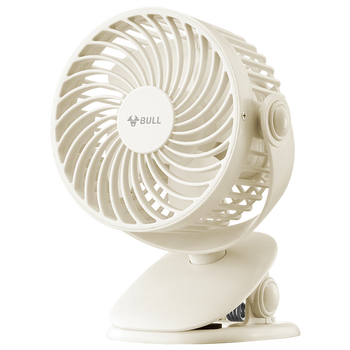

公牛USB桌面风扇 迷你轻音小电扇 家用卧室学生宿舍办公室台式桌面扇台夹扇 立挂两用

公牛USB桌面风扇 迷你轻音小电扇 家用卧室学生宿舍办公室台式桌面扇台夹扇 立挂两用

ANKER安克30W冰点充 苹果17充电器type-c快充pd氮化镓适用iPhone16promax15/14apple手机iPad插头 白

ANKER安克30W冰点充 苹果17充电器type-c快充pd氮化镓适用iPhone16promax15/14apple手机iPad插头 白

ThinkPlus【新3C认证】联想锋行者140W快充20000毫安时笔记本充电宝拯救者y7000pPD协议适用苹果17华为联想

ThinkPlus【新3C认证】联想锋行者140W快充20000毫安时笔记本充电宝拯救者y7000pPD协议适用苹果17华为联想

微星(MSI)27英寸2K500Hz QD-OLED显示器 0.03ms(GTG) HDR500游戏电竞显示屏MAG 272QP QD-OLED X50流光X50

微星(MSI)27英寸2K500Hz QD-OLED显示器 0.03ms(GTG) HDR500游戏电竞显示屏MAG 272QP QD-OLED X50流光X50

闪魔(SmartDevil)适用于华为Pura70钢化膜 p70手机膜高清0黑边不挡屏全屏防爆指纹防摔手机保护膜

闪魔(SmartDevil)适用于华为Pura70钢化膜 p70手机膜高清0黑边不挡屏全屏防爆指纹防摔手机保护膜

网友评论