近日,红帽公司宣布即将在红帽OpenShift AI上集成NVIDIA NIM微服务,从而为数十种AI模型提供优化推理,这些模型由一致的开源AI/ML混合云平台支持。企业将能够使用红帽OpenShift AI与NVIDIA NIM在一个可信赖的MLOps平台上开发新一代人工智能驱动的应用程序。

Nvidia NIM是Nvidia在前不久GTC会议上宣布推出的软件平台,也是 NVIDIA AI Enterprise 的一部分,旨在简化定制和预先训练的 AI 模型在生产环境中的部署。NIM 继承了 Nvidia 围绕推理和优化模型所做的软件工作,并通过将给定模型与优化的推理引擎相结合,然后将其打包到容器中,使其作为微服务进行访问,从而使其易于访问。

作为此次最新合作的一部分,NVIDIA将使NIM与KServe实现互操作性,KServe是一个基于Kubernetes的开源项目,用于高度可扩展的人工智能用例,也是红帽OpenShift人工智能的核心上游贡献者。这将有助于在红帽OpenShift AI的未来迭代中推动NVIDIA NIM微服务的持续互操作性。

通过使用红帽OpenShift AI和NVIDIA NIM,企业可以受益于:

*简化集成路径,将NVIDIA NIM部署到与其他AI部署一起的通用工作流中,以实现更高的一致性和更轻松的管理。

* NVIDIA NIM部署的集成扩展和监控,与混合云环境中的其他AI模型部署协调。

*企业级的安全性、支持和稳定性,确保在AI上运行业务的企业从原型顺利过渡到生产。

NVIDIA NIM微服务旨在加速GenAI在企业中的部署。NIM支持广泛的人工智能模型,包括开源社区模型、NVIDIA AI基金会模型和自定义模型,通过行业标准的应用程序编程接口(api)在本地或云中提供无缝的、可扩展的人工智能推理。

aigo 爱国者 P3500 固态硬盘 M.2接口 1TB

aigo 爱国者 P3500 固态硬盘 M.2接口 1TB

Apple 苹果 iPad Air 5 2022款 10.9英寸平板电脑 64GB WLAN版

Apple 苹果 iPad Air 5 2022款 10.9英寸平板电脑 64GB WLAN版

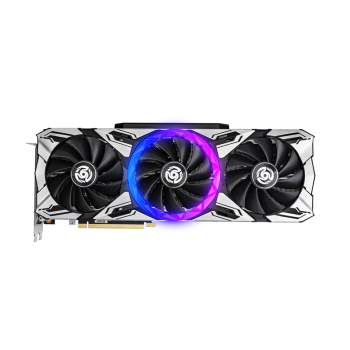

新补货:ZOTAC 索泰 RTX4070 SUPER 12G 天启 OC 独立显卡

新补货:ZOTAC 索泰 RTX4070 SUPER 12G 天启 OC 独立显卡

Imou 乐橙 TA3 400万高清监控 360全景家用摄像头

Imou 乐橙 TA3 400万高清监控 360全景家用摄像头

360 11X 4G儿童智能手表

360 11X 4G儿童智能手表

Apple 苹果 Watch Series 9 智能手表 GPS+蜂窝网络款 45mm 银色铝金属表壳 凛蓝色回环式运动表带

Apple 苹果 Watch Series 9 智能手表 GPS+蜂窝网络款 45mm 银色铝金属表壳 凛蓝色回环式运动表带

SAMSUNG 三星 980 PRO M.2接口 固态硬盘 1TB(PCI-E4.0) 散热片版

SAMSUNG 三星 980 PRO M.2接口 固态硬盘 1TB(PCI-E4.0) 散热片版

360 家用监控摄像头智能摄像机 3K云台版500万双频wifi超高清星光微光全彩双向通话母婴看护 云台8Max AI版

360 家用监控摄像头智能摄像机 3K云台版500万双频wifi超高清星光微光全彩双向通话母婴看护 云台8Max AI版

Apple 苹果 Mac mini 台式电脑主机 (M2 Pro、16GB、512G SSD)

Apple 苹果 Mac mini 台式电脑主机 (M2 Pro、16GB、512G SSD)

网友评论