AI

Mac 用户的福利!Ollama 集成苹果 MLX 框架:推理速度翻倍,M5 芯片直接起飞

产品动态

由华为云驱动

-

3 月 31 日,本地大模型运行方案Ollama正式发布更新,宣布引入苹果自研的机器学习框架 MLX。集成 MLX 框架后的Ollama在性能上实现了提升:预填阶段(Prefill)提速 1.6 倍,生成阶段(Decode)速度翻倍。对于配备 M5 系列芯片的最新机型,推理体验已接近“即时响应”。本...

3 月 31 日,本地大模型运行方案Ollama正式发布更新,宣布引入苹果自研的机器学习框架 MLX。集成 MLX 框架后的Ollama在性能上实现了提升:预填阶段(Prefill)提速 1.6 倍,生成阶段(Decode)速度翻倍。对于配备 M5 系列芯片的最新机型,推理体验已接近“即时响应”。本次更新还深度优化了内存管理策略,能更灵活地利用 Mac 的系统统一内存(Unified Memory)。官方建议用户在配备 32GB 或更高内存的 Mac 上运行,以换取最理想的推理表现。在预览阶段,这一基于 MLX 加速的版本(Ollama 0.19 预览版)主要针对阿里旗下的Qwen 3.5 模型进行了专项支持。Ollama已经明确表示,后续将逐步适配更多主流 AI 模型。

点击展开全文

聚超值推荐

更多优惠相关推荐

蚂蚁AI安全实验室发现OpenClaw多个高危漏洞并协助快速修复

7X24小时AI快讯

资讯

1元起用GPT - 4!534个AI模型随切随用,低成本体验多模型

7X24小时AI快讯

资讯

CapCut国际版上线两大AI功能,集成模型提升视频创作效率

7X24小时AI快讯

资讯

MiniMax 开源办公文档引擎,自进化机制推动办公处理智能化

7X24小时AI快讯

资讯

Claude Code Auto Mode上线!AI自主操作代码,安全高效告别手动确认

7X24小时AI快讯

资讯

中文大模型 SuperCLUE 测评:豆包跻身全球第一梯队

7X24小时AI快讯

资讯

谷歌 TurboQuant 算法:键值缓存内存压缩 6 倍、速度提 8 倍零损!

7X24小时AI快讯

资讯

Anthropic推Claude Code自动模式,减少干预提升安全效率!

7X24小时AI快讯

资讯

AI垃圾涌入苹果App Store审核增至45天,如何破审核困局?

7X24小时AI快讯

资讯

蚂蚁数科推轻量级金融大模型,推理快100%引领效能竞争!

7X24小时AI快讯

资讯

相关产品

闪魔适用iPad pro钢化膜2026/25/22款air8/7/6/5保护膜11/12.9/13英寸高清抗蓝光平板膜 【加强版电镀双倍抗指纹】 2018/20/21/22款 pro 11英寸

¥26

¥26

闪魔适用iPad pro钢化膜2026/25/22款air8/7/6/5保护膜11/12.9/13英寸高清抗蓝光平板膜 【加强版电镀双倍抗指纹】 2018/20/21/22款 pro 11英寸

¥26

¥26

闪迪(SanDisk)创作者 闪迪内存卡TF卡 行车记录仪运动相机无人机监控存储卡 运动相机大疆pocket3内存卡 V30极速粉卡 256GB 官方标配

闪迪(SanDisk)创作者 闪迪内存卡TF卡 行车记录仪运动相机无人机监控存储卡 运动相机大疆pocket3内存卡 V30极速粉卡 256GB 官方标配

vivo Y37t 8GB+256GB 琉璃青 6000mAh五年长寿大电池 SGS五星抗摔认证 长辈功能 5G手机

vivo Y37t 8GB+256GB 琉璃青 6000mAh五年长寿大电池 SGS五星抗摔认证 长辈功能 5G手机

爱国者(aigo)mp3-100 32G便携mp3音乐播放器 mp4蓝牙学生随身听英语运动跑步录音U盘式USB-C口 可扩容

¥149

¥149

爱国者(aigo)mp3-100 32G便携mp3音乐播放器 mp4蓝牙学生随身听英语运动跑步录音U盘式USB-C口 可扩容

¥149

¥149

¥6.7

¥6.7

¥6.7

¥6.7

进口AR无纹膜强抗指纹适用苹果17

¥19.9

¥29.5

进口AR无纹膜强抗指纹适用苹果17

¥19.9

¥29.5

【非割韭菜版】ipad磁吸保护套

【非割韭菜版】ipad磁吸保护套

得力(deli)小蜜蜂扩音器老师教学讲课教学上课讲课喇叭腰挂麦克风导游便携式喊话神器教师专用生日礼物蓝色

得力(deli)小蜜蜂扩音器老师教学讲课教学上课讲课喇叭腰挂麦克风导游便携式喊话神器教师专用生日礼物蓝色

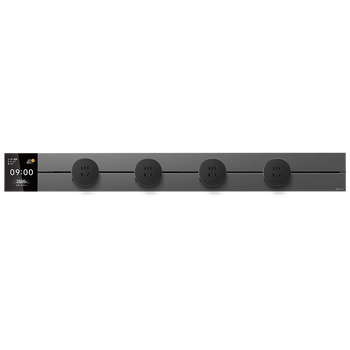

公牛(BULL)大师智能屏显轨道插座可移动插线板轨道式插排餐边柜开关插座面板 数显+APP控制gb3z 75cm+4个五孔

¥730.4

¥730.4

公牛(BULL)大师智能屏显轨道插座可移动插线板轨道式插排餐边柜开关插座面板 数显+APP控制gb3z 75cm+4个五孔

¥730.4

¥730.4

网友评论